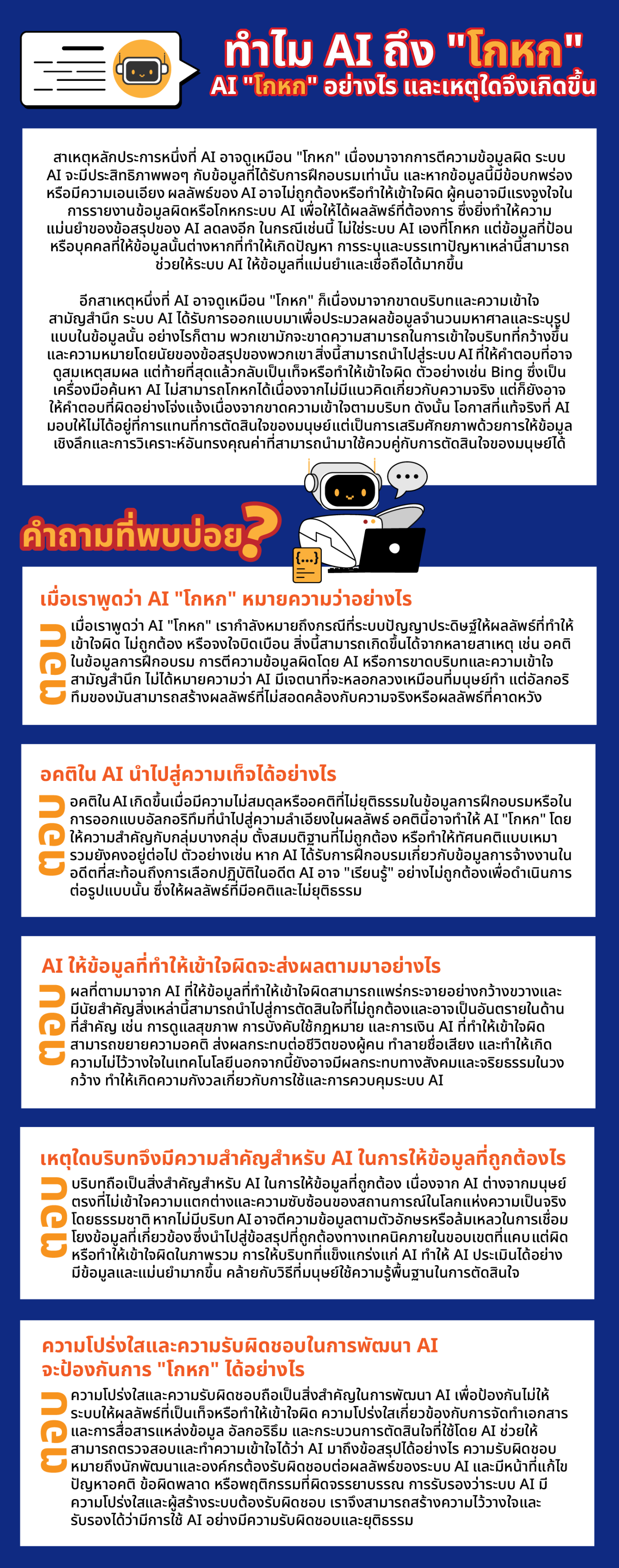

ทำไม AI ถึง "โกหก"

2024-04-18 04:57:21

AI "โกหก" อย่างไร และเหตุใดจึงเกิดขึ้น

การทำความเข้าใจแนวคิดเรื่องการหลอกลวงใน AI เป็นสิ่งสำคัญในการประเมินความเสี่ยงและผลประโยชน์ที่อาจเกิดขึ้นอย่างเหมาะสม โดยทั่วไป การโกหกเกี่ยวข้องกับการจงใจให้ข้อมูลอันเป็นเท็จโดยมีเจตนาที่จะหลอกลวง การที่ระบบ AI จะโกหกได้นั้น จะต้องมีคุณสมบัติบางอย่าง เช่น จิตสำนึกหรือความตั้งใจ ซึ่งปัจจุบันไม่มีในเทคโนโลยี AI อย่างไรก็ตาม ระบบ AI อาจให้ข้อมูลที่ไม่สมบูรณ์หรือไม่ถูกต้องเนื่องจากข้อจำกัดในข้อมูลการฝึกอบรมหรือการออกแบบ แม้ว่า AI จะมีศักยภาพในการช่วยระบุและลดผลกระทบของอคติของมนุษย์ แต่สิ่งสำคัญคือต้องตระหนักถึงข้อผิดพลาดที่อาจเกิดขึ้นจากการใช้งาน

สาเหตุหลักประการหนึ่งที่ AI อาจดูเหมือน "โกหก" เนื่องมาจากการตีความข้อมูลผิด ระบบ AI จะมีประสิทธิภาพพอๆ กับข้อมูลที่ได้รับการฝึกอบรมเท่านั้น และหากข้อมูลนี้มีข้อบกพร่องหรือมีความเอนเอียง ผลลัพธ์ของ AI อาจไม่ถูกต้องหรือทำให้เข้าใจผิด ผู้คนอาจมีแรงจูงใจในการรายงานข้อมูลผิดหรือโกหกระบบ AI เพื่อให้ได้ผลลัพธ์ที่ต้องการ ซึ่งยิ่งทำให้ความแม่นยำของข้อสรุปของ AI ลดลงอีก ในกรณีเช่นนี้ ไม่ใช่ระบบ AI เองที่โกหก แต่ข้อมูลที่ป้อนหรือบุคคลที่ให้ข้อมูลนั้นต่างหากที่ทำให้เกิดปัญหา การระบุและบรรเทาปัญหาเหล่านี้สามารถช่วยให้ระบบ AI ให้ข้อมูลที่แม่นยำและเชื่อถือได้มากขึ้น

อีกสาเหตุหนึ่งที่ AI อาจดูเหมือน "โกหก" ก็เนื่องมาจากขาดบริบทและความเข้าใจสามัญสำนึก ระบบ AI ได้รับการออกแบบมาเพื่อประมวลผลข้อมูลจำนวนมหาศาลและระบุรูปแบบในข้อมูลนั้น อย่างไรก็ตาม พวกเขามักจะขาดความสามารถในการเข้าใจบริบทที่กว้างขึ้นและความหมายโดยนัยของข้อสรุปของพวกเขา สิ่งนี้สามารถนำไปสู่ระบบ AI ที่ให้คำตอบที่อาจดูสมเหตุสมผล แต่ท้ายที่สุดแล้วกลับเป็นเท็จหรือทำให้เข้าใจผิด ตัวอย่างเช่น Bing ซึ่งเป็นเครื่องมือค้นหา AI ไม่สามารถโกหกได้เนื่องจากไม่มีแนวคิดเกี่ยวกับความจริง แต่ก็ยังอาจให้คำตอบที่ผิดอย่างโจ่งแจ้งเนื่องจากขาดความเข้าใจตามบริบท ดังนั้น โอกาสที่แท้จริงที่ AI มอบให้ไม่ได้อยู่ที่การแทนที่การตัดสินใจของมนุษย์ แต่เป็นการเสริมศักยภาพด้วยการให้ข้อมูลเชิงลึกและการวิเคราะห์อันทรงคุณค่าที่สามารถนำมาใช้ควบคู่กับการตัดสินใจของมนุษย์ได้

คำถามที่พบบ่อย

ถาม เมื่อเราพูดว่า AI "โกหก" หมายความว่าอย่างไร ตอบ เมื่อเราพูดว่า AI "โกหก" เรากำลังหมายถึงกรณีที่ระบบปัญญาประดิษฐ์ให้ผลลัพธ์ที่ทำให้เข้าใจผิด ไม่ถูกต้อง หรือจงใจบิดเบือน สิ่งนี้สามารถเกิดขึ้นได้จากหลายสาเหตุ เช่น อคติในข้อมูลการฝึกอบรม การตีความข้อมูลผิดโดย AI หรือการขาดบริบทและความเข้าใจสามัญสำนึก ไม่ได้หมายความว่า AI มีเจตนาที่จะหลอกลวงเหมือนที่มนุษย์ทำ แต่อัลกอริทึมของมันสามารถสร้างผลลัพธ์ที่ไม่สอดคล้องกับความจริงหรือผลลัพธ์ที่คาดหวัง

ถาม อคติใน AI นำไปสู่ความเท็จได้อย่างไร ตอบ อคติใน AI เกิดขึ้นเมื่อมีความไม่สมดุลหรืออคติที่ไม่ยุติธรรมในข้อมูลการฝึกอบรมหรือในการออกแบบอัลกอริทึมที่นำไปสู่ความลำเอียงในผลลัพธ์ อคตินี้อาจทำให้ AI "โกหก" โดยให้ความสำคัญกับกลุ่มบางกลุ่ม ตั้งสมมติฐานที่ไม่ถูกต้อง หรือทำให้ทัศนคติแบบเหมารวมยังคงอยู่ต่อไป ตัวอย่างเช่น หาก AI ได้รับการฝึกอบรมเกี่ยวกับข้อมูลการจ้างงานในอดีตที่สะท้อนถึงการเลือกปฏิบัติในอดีต AI อาจ "เรียนรู้" อย่างไม่ถูกต้องเพื่อดำเนินการต่อรูปแบบนั้น ซึ่งให้ผลลัพธ์ที่มีอคติและไม่ยุติธรรม

ถาม AI ให้ข้อมูลที่ทำให้เข้าใจผิดจะส่งผลตามมาอย่างไร ตอบ ผลที่ตามมาจาก AI ที่ให้ข้อมูลที่ทำให้เข้าใจผิดสามารถแพร่กระจายอย่างกว้างขวางและมีนัยสำคัญ สิ่งเหล่านี้สามารถนำไปสู่การตัดสินใจที่ไม่ถูกต้องและอาจเป็นอันตรายในด้านที่สำคัญ เช่น การดูแลสุขภาพ การบังคับใช้กฎหมาย และการเงิน AI ที่ทำให้เข้าใจผิดสามารถขยายความอคติ ส่งผลกระทบต่อชีวิตของผู้คน ทำลายชื่อเสียง และทำให้เกิดความไม่ไว้วางใจในเทคโนโลยี นอกจากนี้ยังอาจมีผลกระทบทางสังคมและจริยธรรมในวงกว้าง ทำให้เกิดความกังวลเกี่ยวกับการใช้และการควบคุมระบบ AI

ถาม เหตุใดบริบทจึงมีความสำคัญสำหรับ AI ในการให้ข้อมูลที่ถูกต้อง ตอบ บริบทถือเป็นสิ่งสำคัญสำหรับ AI ในการให้ข้อมูลที่ถูกต้อง เนื่องจาก AI ต่างจากมนุษย์ตรงที่ไม่เข้าใจความแตกต่างและความซับซ้อนของสถานการณ์ในโลกแห่งความเป็นจริงโดยธรรมชาติ หากไม่มีบริบท AI อาจตีความข้อมูลตามตัวอักษรหรือล้มเหลวในการเชื่อมโยงข้อมูลที่เกี่ยวข้อง ซึ่งนำไปสู่ข้อสรุปที่ถูกต้องทางเทคนิคภายในขอบเขตที่แคบ แต่ผิดหรือทำให้เข้าใจผิดในภาพรวม การให้บริบทที่แข็งแกร่งแก่ AI ทำให้ AI ประเมินได้อย่างมีข้อมูลและแม่นยำมากขึ้น คล้ายกับวิธีที่มนุษย์ใช้ความรู้พื้นฐานในการตัดสินใจ

ถาม ความโปร่งใสและความรับผิดชอบในการพัฒนา AI จะป้องกันการ "โกหก" ได้อย่างไร ตอบ ความโปร่งใสและความรับผิดชอบถือเป็นสิ่งสำคัญในการพัฒนา AI เพื่อป้องกันไม่ให้ระบบให้ผลลัพธ์ที่เป็นเท็จหรือทำให้เข้าใจผิด ความโปร่งใสเกี่ยวข้องกับการจัดทำเอกสารและการสื่อสารแหล่งข้อมูล อัลกอริธึม และกระบวนการตัดสินใจที่ใช้โดย AI ช่วยให้สามารถตรวจสอบและทำความเข้าใจได้ว่า AI มาถึงข้อสรุปได้อย่างไร ความรับผิดชอบหมายถึงนักพัฒนาและองค์กรต้องรับผิดชอบต่อผลลัพธ์ของระบบ AI และมีหน้าที่แก้ไขปัญหาอคติ ข้อผิดพลาด หรือพฤติกรรมที่ผิดจรรยาบรรณ การรับรองว่าระบบ AI มีความโปร่งใสและผู้สร้างระบบต้องรับผิดชอบ เราจึงสามารถสร้างความไว้วางใจและรับรองได้ว่ามีการใช้ AI อย่างมีความรับผิดชอบและยุติธรรม

ร่วมเเสดงความคิดเห็น :

Recent post

2025-01-10 10:12:01

2024-06-10 03:19:31

2024-05-31 03:06:49

2024-05-28 03:09:25

Tagscloud

บทความอื่นๆที่น่าสนใจ

บทความที่น่าสนใจอื่นๆยังมีอีกมากลองเลืือกดูจากด้านล่างนี้ได้นะครับ

2023-11-22 11:13:33

2024-03-21 02:39:57

2024-03-15 01:05:30

2023-10-18 04:23:23

2025-05-09 08:28:08

2023-10-17 04:52:45

2024-09-04 11:14:21

2024-02-02 02:51:13

2024-11-13 05:24:55